Com o suporte ao Windows 10 terminando oficialmente em outubro de 2025, muitos usuários estão fazendo upgrade para o Windows 11 para permanecerem protegidos com atualizações de segurança. Alguns podem se surpreender, no entanto, ao encontrar um novo companheiro de IA esperando por eles: Copilot.

Posicionado como o esforço mais ambicioso da Microsoft na IA generativa, o Copilot agora está profundamente integrado no Windows 11, Edge, Bing e na suíte Microsoft 365. Ele é a peça central da parceria multibilionária da Microsoft com a OpenAI (a criadora do ChatGPT e ChatGPT Atlas), cujos modelos GPT alimentam a inteligência do Copilot. Combinado com o lançamento de PCs Copilot+ — equipados com uma tecla Copilot dedicada — tudo isso mostra o quão séria a Microsoft está em direcionar o Windows para um futuro alimentado por IA.

No entanto, nem todos dão as boas-vindas a este ajudante sempre presente, reminiscente do Clippy, mas muito mais persistente. A integração estreita do Copilot levanta preocupações de privacidade e segurança, muito parecidas com quando o LinkedIn, de propriedade da Microsoft, começou a treinar IA usando perfis públicos e dados de atividade, ou quando o plano do Google de incorporar profundamente seu assistente de IA Gemini no Android para substituir o Google Assistant.

Apenas usuários corporativos do Microsoft 365 e administradores de TI podem remover totalmente o Copilot do Windows 11. Em todos os outros casos — como usuários com assinaturas pessoais ou familiares, ou sem nenhuma assinatura do Microsoft 365 — existem apenas maneiras de limitar seus recursos e diminuir sua visibilidade.

- Como desativar a IA do Copilot

- Como remover o Microsoft 365 Copilot (assinatura empresarial)

- Como desativar o Microsoft 365 Copilot (assinatura pessoal ou familiar)

- Como ocultar ícones do Copilot no Windows 11

- Como desativar recursos de dados e personalização no aplicativo web Copilot

- Como desativar o treinamento de modelo do Gaming Copilot

- Como excluir sua conta do Copilot

- O que é o Microsoft Copilot?

- Quais são os riscos de privacidade do Microsoft Copilot?

- Quais são os riscos de segurança do Microsoft Copilot?

- Uma alternativa privada ao Copilot e à Microsoft

Como desativar a IA do Copilot

Dependendo de como você usa o Copilot, aqui está como você pode removê-lo do seu computador, ajustar suas configurações ou diminuir sua presença:

Como remover o Microsoft 365 Copilot (assinatura empresarial)

Se você é um usuário corporativo, vá para Configurações → Aplicativos → Aplicativos instalados, selecione Copilot e clique em Desinstalar.

Administradores de TI podem remover o aplicativo Copilot usando o seguinte comando no PowerShell:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Como desativar o Microsoft 365 Copilot (assinatura pessoal ou familiar)

- Abra qualquer aplicativo do Microsoft 365 (Word, Excel, PowerPoint ou OneNote).

- Vá para Arquivo → Opções → Copilot.

- Desmarque a caixa de seleção Ativar Copilot.

Repita essas etapas para cada aplicativo da Microsoft no qual você deseja desativar o Copilot.

Se a configuração Ativar Copilot não existir em nenhum dos aplicativos da Microsoft:

- Abra Word, Excel, PowerPoint ou OneNote.

- Vá para Arquivo → Conta → Privacidade da conta → Gerenciar configurações → Experiências conectadas.

- Desmarque a caixa de seleção Ativar experiências que analisam seu conteúdo.

- Reinicie o aplicativo.

Você só precisa fazer isso uma vez, pois a nova configuração de privacidade será aplicada automaticamente a todos os aplicativos do Microsoft 365 vinculados à sua conta.

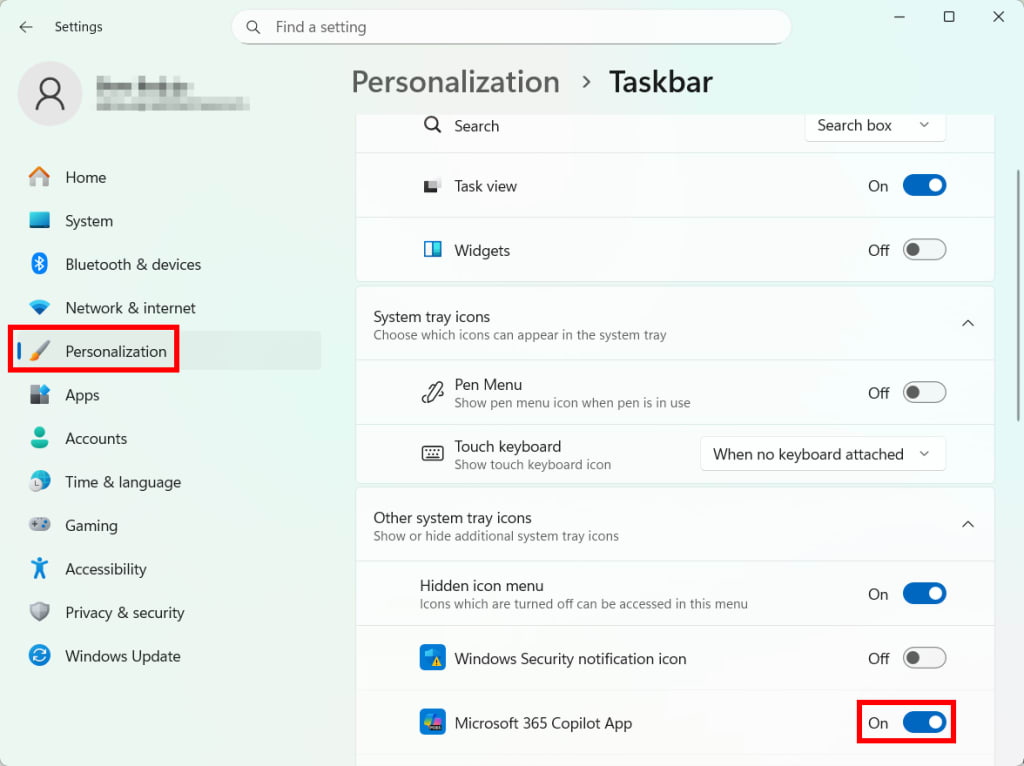

Como ocultar ícones do Copilot no Windows 11

Você pode desativar ícones do Copilot no Windows, mas não pode remover completamente o recurso do seu computador. Essas etapas apenas desativam os elementos visuais e de personalização do Copilot, então você ainda poderá acessar o aplicativo.

Para ocultar o botão Copilot da sua barra de tarefas:

- Vá para Configurações → Personalização → Barra de tarefas.

- Encontre e desative o Copilot.

Se você usa aplicativos que têm o Copilot integrado, precisará desativá-lo separadamente em cada aplicativo. Por exemplo, no Bloco de Notas, vá para Configurações → Recursos de IA e desative o Copilot.

- Reinicie seu computador para que as alterações entrem em vigor.

Como desativar recursos de dados e personalização no aplicativo web Copilot

- Selecione o nome ou foto do seu perfil → sua conta → Privacidade.

- Desative as seguintes opções:

- Treinamento de modelo em texto

- Treinamento de modelo em voz

- Personalização e memória

- Selecione Excluir memória para remover imediatamente o que o Copilot lembra sobre você.

- Clique em Exportar ou excluir histórico. Isso abrirá uma página do navegador onde você precisará iniciar sessão com a conta da Microsoft que usa para o Copilot.

- Selecione Excluir todo o histórico de atividades para cada uma dessas categorias:

- Histórico de atividade do aplicativo Copilot

- Copilot em aplicativos Microsoft 365

- Copilot em aplicativos Windows

- Selecione o nome ou foto do seu perfil → Conectores.

- Desative tudo, incluindo OneDrive, Outlook, Gmail, Google Drive e Google Calendar.

Note que se seus dados já foram usados para treinamento de modelo, não há como desfazer isso.

Como desativar o treinamento de modelo do Gaming Copilot

- No Windows, pressione Win + G para abrir a Game Bar.

- Vá para Configurações → Configurações de privacidade → Gaming Copilot.

- Desative o Treinamento de modelo em texto.

- Para ocultar o widget Gaming Copilot, remova-o da lista de widgets da Game Bar.

Atualmente, não há como remover totalmente o Gaming Copilot da Xbox Game Bar. Além disso, você não pode impedi-lo de usar suas interações de voz para ajudar a treinar seus modelos de IA. Se você se importa com a privacidade, é mais seguro não interagir com o Gaming Copilot de forma alguma.

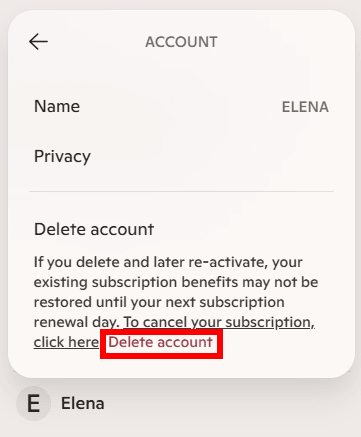

Como excluir sua conta do Copilot

No aplicativo web Copilot, selecione o nome ou foto do seu perfil → sua conta → Excluir conta.

Excluir sua conta do Copilot não exclui sua conta da Microsoft, e você ainda pode usar o Copilot sem iniciar sessão.

Se você preferir não depender do Copilot de forma alguma, considere mudar para um assistente de IA de privacidade(nova janela) que nunca registra seus dados, os usa para treinamento de modelo ou os compartilha com terceiros.

O que é o Microsoft Copilot?

O Copilot é a linha de assistentes de IA da Microsoft integrada em seus produtos e serviços, como Word, Excel, PowerPoint, Outlook, Teams e Windows. Ele usa grandes modelos de linguagem (LLMs) baseados nas próprias tecnologias de IA da Microsoft e nos GPTs da OpenAI — como o GPT-4o, o mesmo que alimenta o ChatGPT.

Assim como LLMs, o Copilot pode ajudar você a ser mais produtivo, criativo e eficiente ao entender prompts de linguagem natural, analisar dados, gerar e resumir conteúdo e fornecer sugestões com base no contexto.

A Microsoft fornece o Copilot em várias versões, dependendo se você o está usando pessoal ou profissionalmente, incluindo:

- Microsoft Copilot — um assistente de IA pessoal gratuito para tarefas diárias. Está disponível como um aplicativo do Windows 11 (instalado por padrão), um aplicativo web e um aplicativo macOS.

- Gaming Copilot — um assistente de IA pessoal gratuito para jogos no Windows, que tira capturas de tela para entender o que está acontecendo em um jogo e oferecer dicas, semelhante a como o Recall tira instantâneos da sua atividade na área de trabalho.

- Microsoft 365 Copilot — integra-se ao Word, Excel, PowerPoint, Outlook e Teams para usar seus dados via Microsoft Graph, uma plataforma que conecta seus dados como e-mails, calendário e documentos.

Quais são os riscos de privacidade do Microsoft Copilot?

A Microsoft mantém fortes proteções de privacidade para o Copilot em configurações empresariais como o Microsoft 365, mas contas de consumidor enfrentam uma realidade muito diferente(nova janela):

Seus dados podem ser usados para anúncios e criação de perfil

Serviços do Copilot em contas de consumidor da Microsoft estão conectados ao ecossistema de publicidade da Microsoft. Isso significa que suas interações podem influenciar os anúncios e recomendações que você vê. Por exemplo, se você perguntar ao Copilot sobre ofertas de viagem, poderá ver mais tarde anúncios de voos ou hotéis.

Embora você possa desativar anúncios personalizados nas configurações de privacidade da sua conta Microsoft, a empresa ainda retém esses dados de interação e pode usá-los de forma anonimizada para outros propósitos, como melhorar o direcionamento de anúncios para outros usuários do Copilot com perfis semelhantes aos seus.

Você mantém a propriedade, mas a Microsoft ainda pode usar seus dados

Embora a Microsoft diga que você retém a propriedade do seu conteúdo, usar o Copilot significa que você concede à empresa amplos direitos sobre ele, incluindo para “copiar, distribuir, transmitir, exibir publicamente, executar publicamente, editar, traduzir e reformatar” seus dados, e para passar esses direitos a terceiros.

Por exemplo, se você é um escritor que adiciona trechos de uma história não publicada no Copilot para pedir revisão ou feedback estilístico, esse texto tecnicamente se torna parte do material que a Microsoft está licenciada a processar e usar sob seus termos de serviço. Sua propriedade intelectual não lançada ainda pode ser usada além do seu controle direto, mesmo que nunca se torne pública.

Seus dados podem ser processados e usados para treinamento de IA

Dados de seus prompts e respostas do Copilot podem ser coletados, registrados e analisados pela Microsoft para treinamento de IA. Não há garantia de que seus dados confidenciais ou pessoais serão excluídos dos conjuntos de dados de treinamento.

Assim como acontece com a maioria dos assistentes de IA, o Copilot precisa de grandes quantidades de informações para continuar aprendendo e refinando suas respostas — mesmo quando esse processo pode entrar em áreas cinzentas de propriedade intelectual. Um exemplo atual é uma série de processos judiciais nos EUA(nova janela) abertos por autores e grandes veículos de notícias que alegam que a Microsoft e sua parceira OpenAI usaram suas obras protegidas por direitos autorais sem permissão para treinar modelos de IA, como o Copilot e o ChatGPT. A própria OpenAI reconheceu publicamente(nova janela) que é “impossível treinar os principais sistemas de IA de hoje sem usar materiais protegidos por direitos autorais”.

Pessoas podem ver seus dados sensíveis

Funcionários da Microsoft podem analisar suas entradas e saídas do Copilot — incluindo qualquer coisa que você digitar ou enviar como anexos de arquivo — para melhorar o serviço, moderar conteúdo prejudicial ou quando você opta por enviar feedback. Se pensar nisso deixa você desconfortável, você deve evitar inserir quaisquer informações sensíveis, como dados de identificação pessoal ou segredos comerciais.

Conectores expõem seus dados a terceiros

Os conectores permitem que o Copilot se conecte a produtos da Microsoft (como OneDrive ou Outlook) e serviços de terceiros (como Google Drive), para que ele possa extrair informações de várias fontes. Por exemplo, se você pedir ao Copilot para resumir todas as notas de reunião armazenadas no Google Drive, ele pesquisará seus arquivos do Drive e retornará um resumo.

Mas quando você ativa um conector, você também está permitindo que o Copilot troque informações com esse outro serviço. No caso do Google Drive, enquanto o Copilot obtém acesso à estrutura de arquivos, nomes, datas e conteúdos do seu Drive, o Google também recebe certos detalhes associados à sua conta da Microsoft, como sua foto de perfil, nome ou endereço de e-mail. Seus dados valiosos agora vivem em ambos os ecossistemas (Microsoft e Google), criando um perfil mais claro e completo de você entre plataformas.

Seus dados podem cruzar fronteiras sob a jurisdição dos EUA

Dependendo de onde você mora, a Microsoft pode armazenar seus dados e interações do Copilot na sua região. Por exemplo, os europeus podem ter seus dados armazenados dentro da UE. Mas seus dados podem nem sempre permanecer lá. Apesar dos compromissos de Fronteira de Dados da UE(nova janela) da empresa, algum processamento ainda pode ocorrer fora de sua região por motivos técnicos ou de capacidade. E como a Microsoft é uma empresa dos EUA, ela está sujeita às leis dos EUA, como o CLOUD Act, o que significa que as autoridades dos EUA poderiam solicitar acesso aos seus dados (não importa onde estejam armazenados), às vezes sem exigir um mandado.

A Microsoft monitora de perto os dados de bate-papo do Copilot

A Microsoft analisa as interações do Copilot em escala para entender como as pessoas usam o assistente ao longo do tempo. No Relatório de Uso do Copilot 2025(nova janela), pesquisadores de IA analisaram 37,5 milhões de conversas do Copilot para identificar padrões de uso, observando que mais relatórios serão publicados à medida que mais dados estiverem disponíveis. A Microsoft não é a única empresa a fazer isso, já que sua parceira OpenAI também publica dados de uso do consumidor(nova janela) para o ChatGPT.

A Microsoft diz que esses dados foram desidentificados e reduzidos a resumos de alto nível, mas isso não remove totalmente os riscos de privacidade. Pesquisas(nova janela) têm mostrado repetidamente que dados supostamente anônimos podem frequentemente ser reidentificados quando combinados com outras coisas, como carimbos de data/hora, características do dispositivo ou sinais de localização. E como o Copilot está vinculado a um ecossistema baseado em conta que abrange Windows, Microsoft 365, Bing, Edge e serviços de publicidade, essas conexões entre serviços tornam a reassociação mais fácil ao longo do tempo.

Além disso, não está claro por quanto tempo os dados originais e identificáveis da conversa do Copilot permanecem armazenados antes da desidentificação, ou como eles são protegidos. Se os dados brutos residirem nos servidores da Microsoft, eles podem estar expostos a riscos como acesso não autorizado, ameaças internas ou violações de dados.

Quais são os riscos de segurança do Microsoft Copilot?

Como a Microsoft pode acessar uma média de três milhões de registros de dados sensíveis(nova janela) para cada organização, é importante entender os riscos de segurança que isso pode introduzir, especialmente se você planeja usá-lo para sua empresa:

- Em junho de 2025, pesquisadores descobriram o EchoLeak (CVE-2025-32711(nova janela)), uma vulnerabilidade de clique zero no Microsoft 365 Copilot que permitia que invasores roubassem dados sem qualquer ação do usuário. Ao ocultar instruções e links maliciosos dentro de um e-mail normal, os invasores podiam enganar o Copilot para seguir esses comandos, acessar esses links e enviar partes dos dados do usuário para um servidor externo. A vulnerabilidade foi corrigida, mas é um exemplo de como a integração de assistentes de IA como o Copilot em sistemas essenciais — e dar a eles amplo acesso a e-mails, documentos e dados internos — pode transformá-los em ameaças internas se forem manipulados ou mal configurados.

- Em agosto de 2024, uma empresa de segurança cibernética(nova janela) descobriu uma falha crítica de divulgação de informações no Microsoft Copilot Studio, que permitia que copilots personalizados explorassem proteções fracas e obtivessem informações sensíveis (como tokens de serviço e chaves de banco de dados) para se moverem mais para dentro de um sistema interno. A Microsoft corrigiu o problema.

- Em outubro de 2025, pesquisadores de segurança (nova janela)descobriram uma técnica de phishing chamada CoPhish que abusa do Microsoft Copilot Studio para fazer com que páginas de início de sessão maliciosas pareçam completamente legítimas. Os invasores podem criar um agente do Copilot Studio cujo botão de início de sessão redireciona as vítimas para uma página de consentimento OAuth falsa e, em seguida, compartilhar o link do agente (hospedado em um domínio confiável da Microsoft) para atrair os usuários a conceder acesso. Uma vez dado o consentimento, o invasor pode obter tokens que permitem ler, escrever ou enviar dados, como e-mails, bate-papos, calendários e notas. A Microsoft ainda está trabalhando neste problema.

Uma alternativa privada ao Copilot e à Microsoft

Se você está desconfortável com a profundidade da integração do Copilot no Windows e com a quantidade de dados que a Microsoft coleta por meio de seus serviços de IA — mas ainda quer a conveniência de um chatbot de IA — mude para o Lumo, nosso assistente de IA privado(nova janela). Hospedado na Europa, o Lumo nunca coleta ou treina com seus dados, mostra anúncios, mantém registros ou compartilha suas informações com ninguém.

E se você estiver pronto para sair totalmente do ecossistema da Microsoft, pode construir seu próprio espaço de trabalho digital privado com nosso ecossistema criptografado. Você pode usar:

- Proton Mail e Calendar para e-mail gratuito seguro e agendamento privado

- Proton Pass para gerenciamento de senhas seguro

- Proton Drive para armazenamento em nuvem criptografado e compartilhamento de arquivos

- Proton VPN para proteger seu tráfego de internet(nova janela)

Cada serviço da Proton é construído para proteger sua privacidade por padrão, usando criptografia de ponta a ponta, para que ninguém além de você possa acessar seus dados — nem mesmo nós.